|

Aktuelle Zeit: Do Apr 18, 2024 12:21 Foren-Übersicht » Sonstiges » Projekte |

Unbeantwortete Themen | Aktive Themen |

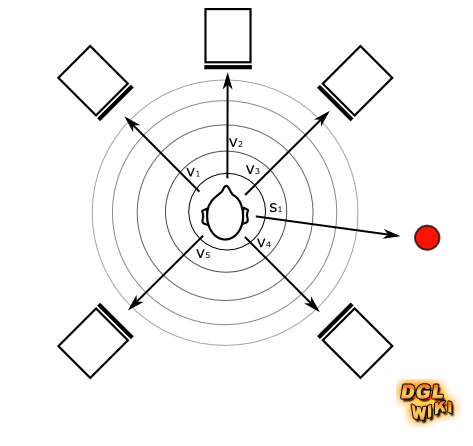

Audorra - Digitale 3D Audiobibliothek

Moderator: DGL-Team

|

|

Seite 1 von 2 |

[ 20 Beiträge ] | Gehe zu Seite 1, 2 Nächste |

|

| Autor | Nachricht | ||||

|---|---|---|---|---|---|

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

|||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

|||||

| Nach oben | ||||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

|||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

|||||

| Nach oben | ||||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

| igel457 |

|

||||

Registriert: Do Jun 28, 2007 17:58 Beiträge: 193 Programmiersprache: Pascal, C |

|

||||

| Nach oben | |||||

|

|

Seite 1 von 2 |

[ 20 Beiträge ] | Gehe zu Seite 1, 2 Nächste |

Wer ist online? |

Mitglieder in diesem Forum: 0 Mitglieder und 37 Gäste |

| Du darfst keine neuen Themen in diesem Forum erstellen. Du darfst keine Antworten zu Themen in diesem Forum erstellen. Du darfst deine Beiträge in diesem Forum nicht ändern. Du darfst deine Beiträge in diesem Forum nicht löschen. Du darfst keine Dateianhänge in diesem Forum erstellen. |